Континуум обчислень: думка Akamai про потреби корпоративного штучного інтелекту на периферії

Куди прямує генеративний штучний інтелект: від центру до крайових зон

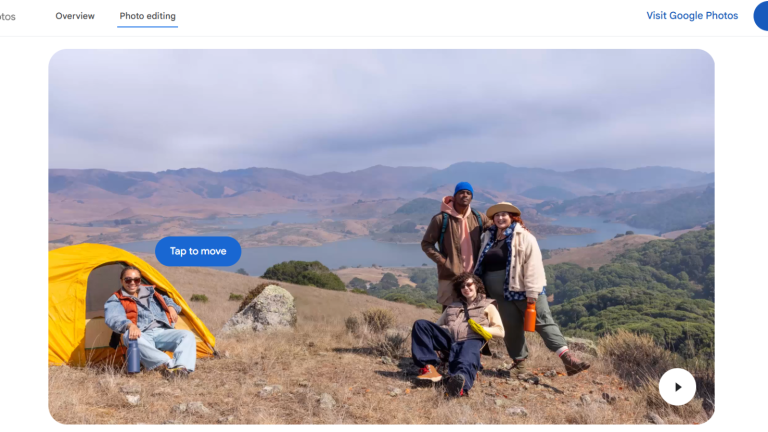

Ранній етап використання генеративного штучного інтелекту в підприємствах відзначався експериментами: створенням моделей, запуском демонстрацій, що підтверджують використання, та тестуваннями, які визначають, чи можуть нові інструменти виконувати корисну роботу. Наступний етап, за словами Joseph Glover з Akamai, — це врахування та реагування на обмеження впровадження AI в крайові середовища, де такими вирішальними факторами стають затримка, стійкість, безпека і розташування даних.

Joseph, Field CTO з Akamai, поглиблено обговорить цю тему на наступному Edge Computing Expo, що пройде в San Jose McEnery Convention Center. Його сесія, “Від AI-Фабрик до Краю: Архітектура Розподіленого Висновку для Розкриття ROI Підприємства”, буде присвячена двом елементам AI, які багато організацій часто зливають: навчанню та висновуванню, і як кожен з них ставить різні вимоги до їхньої підтримуючої інфраструктури.

Головні засоби для навчання великих моделей все ще залишаються в центрі уваги, але що ж відбувається після того, як модель вже навчена і тепер має обслуговувати користувачів чи інші системи в реальному часі? Joseph Glover каже, що AI поводиться інакше на полі, ніж у лабораторії. Для прикладу, застосунок може потребувати швидких відповідей з низькою затримкою, або агенти можуть вимагати кілька викликів інструментів, перш ніж завершити задачу.

Інтелект на краю

Для Glover це значить, що підприємства не повинні сприймати висновування як питання розміщення моделей, а як питання розміщення інтелекту для забезпечення безперервності бізнес-процесів. Це проблема розподілених систем, де висновування у виробничих середовищах потребує врахування маршрутів, спостереження, безпеки, стійкості, резервування та контролю витрат.

Akamai має давню історію у вирішенні проблем розподіленої інфраструктури, що дає їм унікальну позицію в обговоренні крайового AI. Вони витратили десятиліття, розв’язуючи питання маршрутизації трафіка, дотримання правил та підтримки продуктивності глобально. Для Joseph Glover, розподілене висновування саме ставить інтелект у місцях, де насправді відбуваються бізнес-моменти.

Глибше обговорення інфраструктури

Glover зосередиться на розміщенні навантаження: яке має залишатися централізованим, а яке — на краю ближче до користувачів чи машин. Правильний дизайн варіюється в залежності від завдань, скоріше, ніж від загальних переваг. Його послання для учасників Edge Computing Expo полягає в тому, що в міру того як AI переміщується від навчання моделей до забезпечення реального ROI, близькість стає важливішою ніж потужність. Планування має враховувати дійсність великих корпоративних компаній, адже край — це місце, де продуктивність, витрати і стійкість мають більший вплив на бізнес.